ChainOfThought 는 LLM 프롬프트 기법 중 하나며, ‘생각의 사슬' 또는 '일련의 생각' 으로 번역할 수 있다.

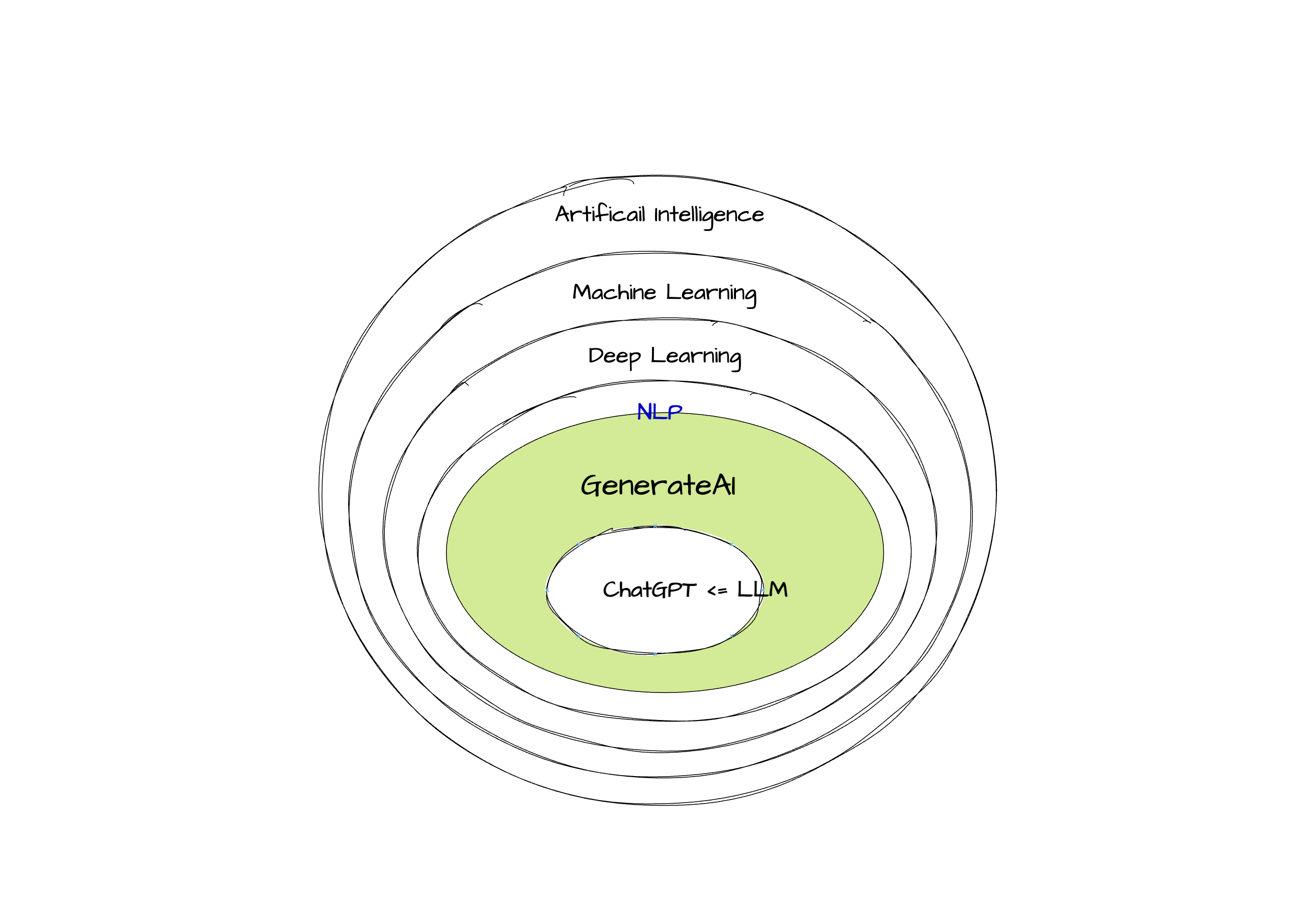

AI 생태계를 양파로 표현해보았다. AI 는 모든 개념을 아우를 수 있는 상위 개념이다. 인간의 지능을 인공적으로 만들겠다는 것. 이를 구현하는 방법 중 하나로 ML(머신러닝)이 있으며, ML 의 확장된 형태가 DL(딥러닝)이다. ML 은 데이터에서 일련의 패턴을 학습한다. DL 은 여기서 한 단계 더 나아간다. 이미지나 영상같은 비정형 데이터까지 학습한다. 이건 더 복잡해진 케이스를 커버한다는 것을 넘어선다. DL은 인간의 신경망에서 아이디어를 얻어 설계된 Deep Neural Network(DNN)를 기반으로 한다. 덕분에 원본 데이터에서 중요 특징(feature)을 자동으로 추출한다. 그 과정에서 패턴을 학습하여 예측을 수행한다.

ChatGPT 를 포함한 오늘날의 LLM 학습 방식은 사실 ML 의 학습 방식을 발전시킨 결과다. 그래서 나는 ML 이 지능을 학습하는 방식을 먼저 알아보았다. 크게 세 가지 방식이 있다. 지도학습, 비지도학습, 강화학습이다. 지도 학습은 정답이 존재하는 데이터에 대한 학습이다. X가 들어오면 Y를 예측하는 식이다. 비지도학습은 반대다. 정답이 존재하지 않아서 숨겨진 구조나 그룹을 찾는 것이 목적이 된다. 사용자 정보를 기반으로 영화를 추천해주는 식이다. 강화학습은 앞에 두 학습 방식과 다르게 데이터가 아닌 환경에서 학습한다. 테슬라의 자율주행이 이 학습방식을 기반으로 동작한다. 도로 환경에서 속도 조절, 차선 변경 등 액션을 스스로 학습한다. 이 학습 방식은 목표는 최적의 결과다. 알파고, 주식 거래 자동화 역시 이 학습 방식을 기반으로 훈련된다.

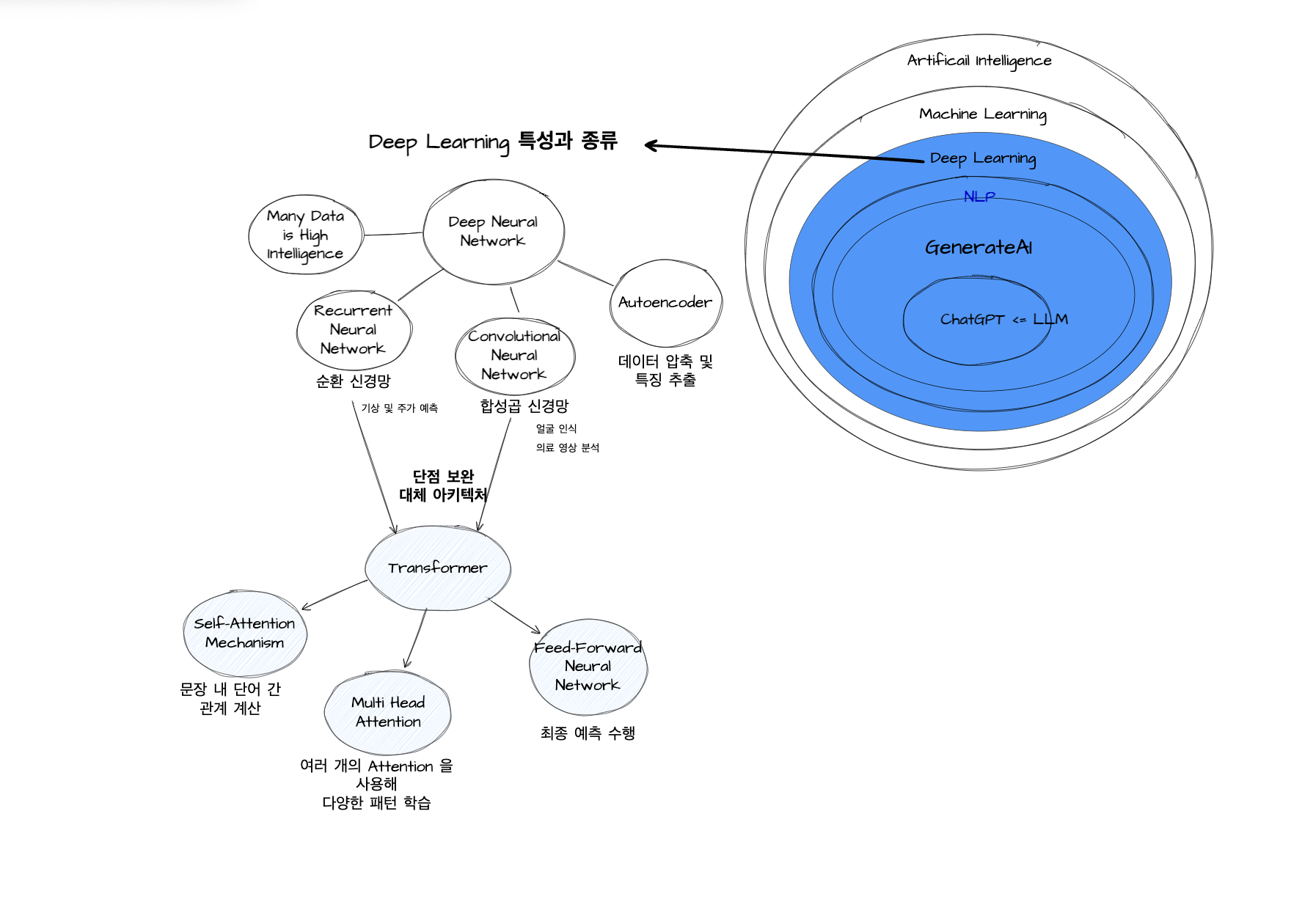

LLM이 계승하는 건 ML만이 아니다. DL의 특성도 관계가 있다. DL 은 데이터가 많을수록 더 딥해진다. 더 많은 데이터가 있을수록 더 많이 학습할 수 있다는 건, 당연하지만 당연하지않다. ML 은 그렇지 않기 때문이다. DL 은 자동으로 학습할 수 있는 프로세스를 가지고 있다. 데이터 내에서 중요 정보를 추출하고 패턴을 학습하며 인지 능력을 높인다. 이미지 같은 경우는 합성곱 신경망을, 텍스트 같은 경우는 순환 신경망을 타며 학습한다.

사실 나는 LLM 에 대해 알고 싶다. 지금까지 알아본 ML, DL 의 지식 수준에서 LLM 까지 가려면 더 많은 연결 고리를 찾아야했다. chain 들을 따라가다보면 LLM 을 더 잘 이해할 수 있지않을까? 여기에 가미할 수 있는 개념을 더 찾아보았다.

Transformer 는 기존 DL 에 존재했던 한계를 극복하기위한 아키텍처다. 병렬 연산이 가능해지면서 학습 속도가 느렸던 RNN/LSTM의 단점을 보완할 수 있었다. 어떻게 가능할까? 모든 단어가 다른 모든 단어와 관계를 가질 수 있도록 한번에 어텐션(Attention) 매트릭스를 계산하기 때문이다. Self-Attention Mechanism 이 여기에 핵심 역할을 한다. 컨텍스트 이해를 순차적으로 처리하는 것이 아니라, 한 번에 모든 단어를 고려한다.

Self-Supervised Learning 은 LLM 같은 대형모델이 활용하는 학습 방식이다. 학습된 데이터를 기반으로 또 다른 학습을 진행하는거다. ML 의 학습 방식을 계승하여 발전 시킨 결과라고 할 수 있다. ChatGPT 역시 이런 방식으로 흐른다. 입력받은 텍스트 데이터를 기반으로 다음 맥락을 이해한다.

LLM의 학습 과정 (Pretraining, Fine-Tuning, RLHF) 은 ML 의 전통적인 학습 과정보다 섬세하다. 먼저 대량의 데이터로 기본적인 언어 패턴을 학습하는 Pretraining 단계가 있다. 그 후 특정한 테스크에 맞게 조정 과정을 거친다. 이 Fine-Tuning 단계에서 법률이나 의료 같은 전문 지식을 습득할 수 있다. 이 후, 사람의 피드백을 발판삼아 모델의 성능을 개선하는 과정을 거친다. 바로 RLHF (Reinforcement Learning from Human Feedback) 다. 강화 학습의 일부다. 나는 ‘사람의 피드백’ 에 집중했다. 오늘날 우리가 말하는 프롬프트와 ‘사람의 피드백’은 얼마나 같고 또 얼마간 다를까?

2편에서 계속

'생각' 카테고리의 다른 글

| Agent 실험 1. 프롬프트 설계 (2) | 2025.04.27 |

|---|---|

| Prompt With Engineering (0) | 2025.03.21 |

| <AI, 네가 뭔데 날 울려> 소개 (3) | 2025.03.17 |

| This is water (0) | 2025.02.22 |

| java.util.concurrent 안에는 뭐가 들었을까 (1) | 2025.01.04 |